AIには100%正解を出す完全なAIと不完全なAIがある

実は私の講演でもネットワークの話のまくらとして「身近になったAI」という話をしました。 主なスライドを引用します。

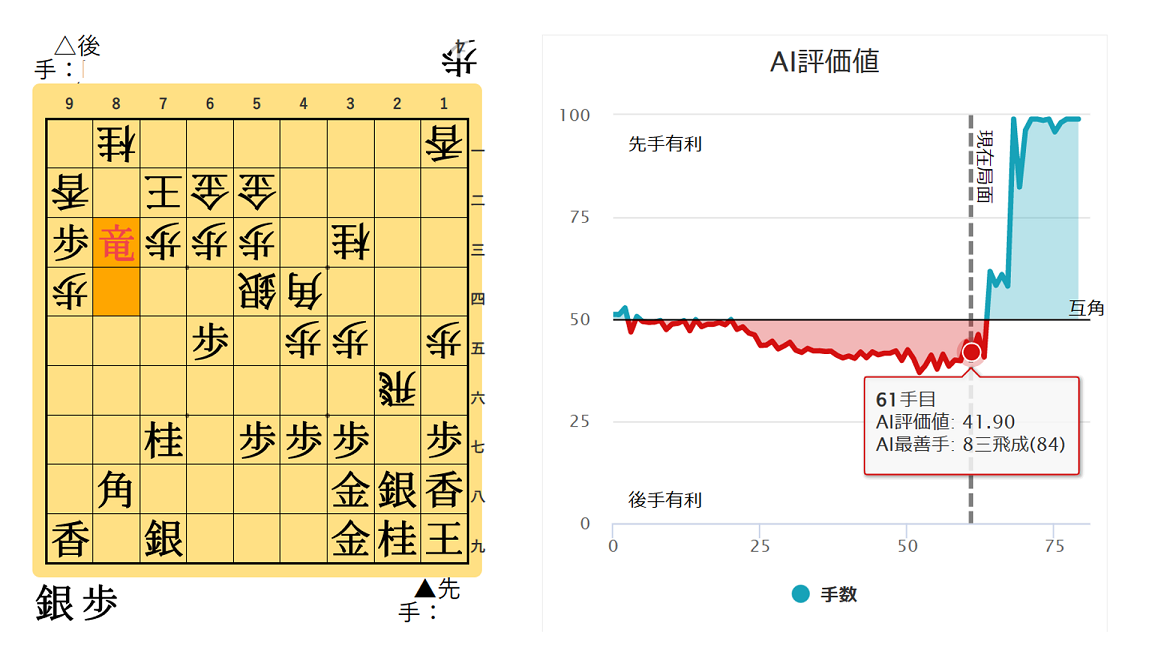

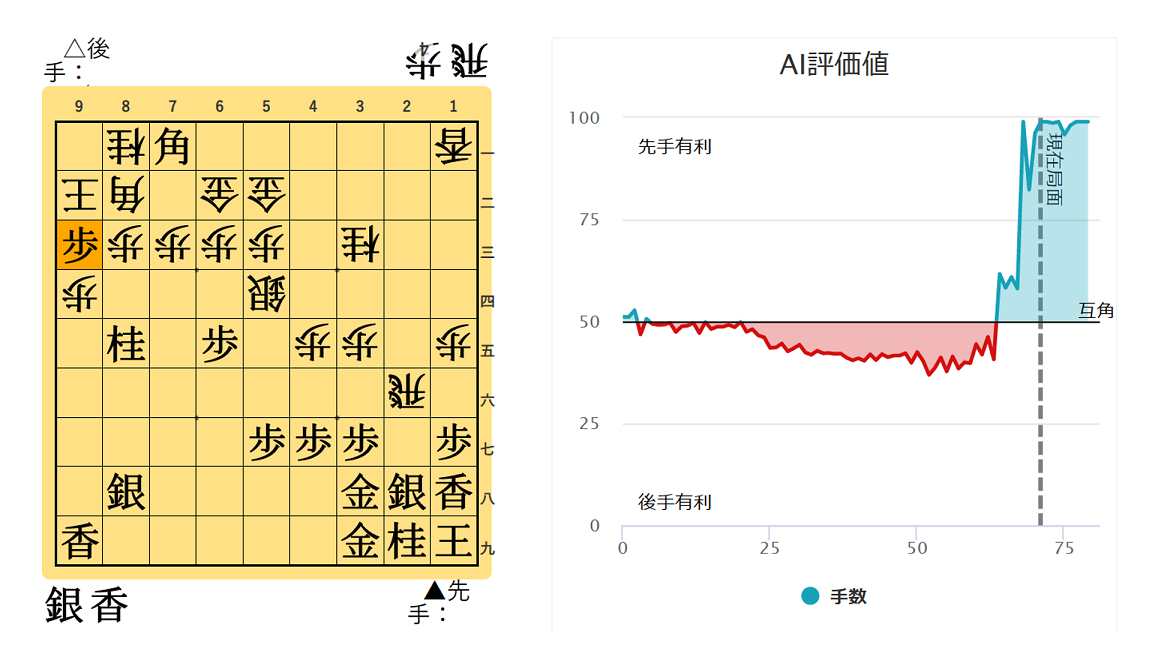

この2枚は私が日本将棋連盟のオンライン将棋倶楽部、「将棋倶楽部24」で指した対局を将棋AIが分析したものです。 先手が私で後手が対局相手です。 1手目から最終の手まで、実際に指された手とAIの最善手が示され、先手・後手のどちらが有利かを示す評価値がグラフ化されています。 将棋AIは2017年に時の名人、佐藤天彦さんに勝ちました。 その時点で将棋ではAIが人間の能力を上回ったのです。 現在の将棋界で最強の藤井聡太6冠王でもAIには勝てません。 将棋AIはつねに100%正解の手を示すことが出来ると言っていいでしょう。 「完全なAI」です。

これに対して「不完全なAI」の代表がChatGPTです。

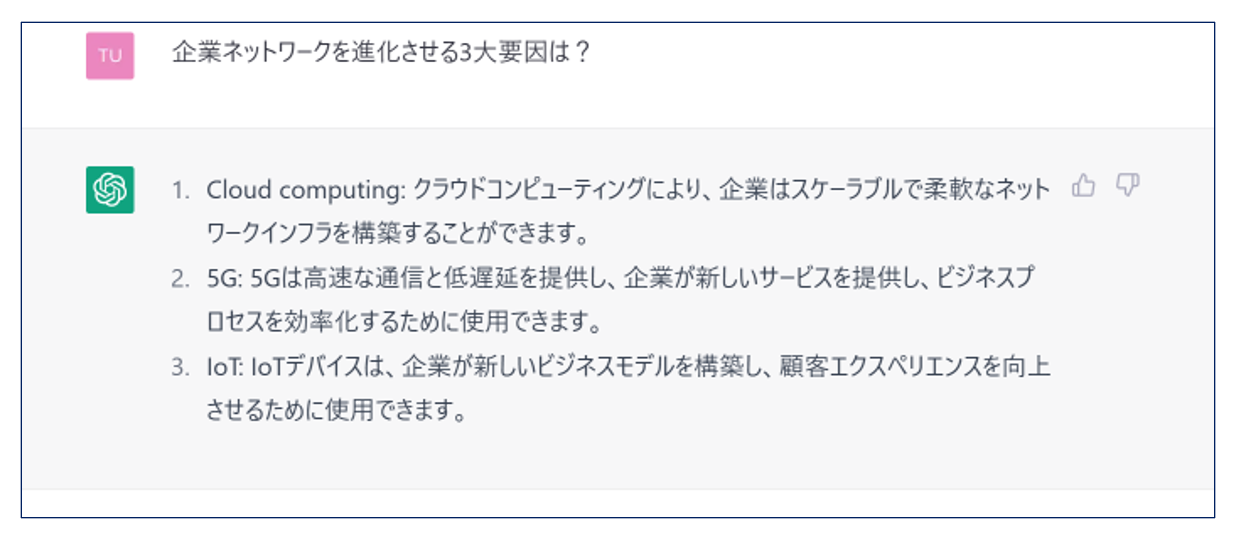

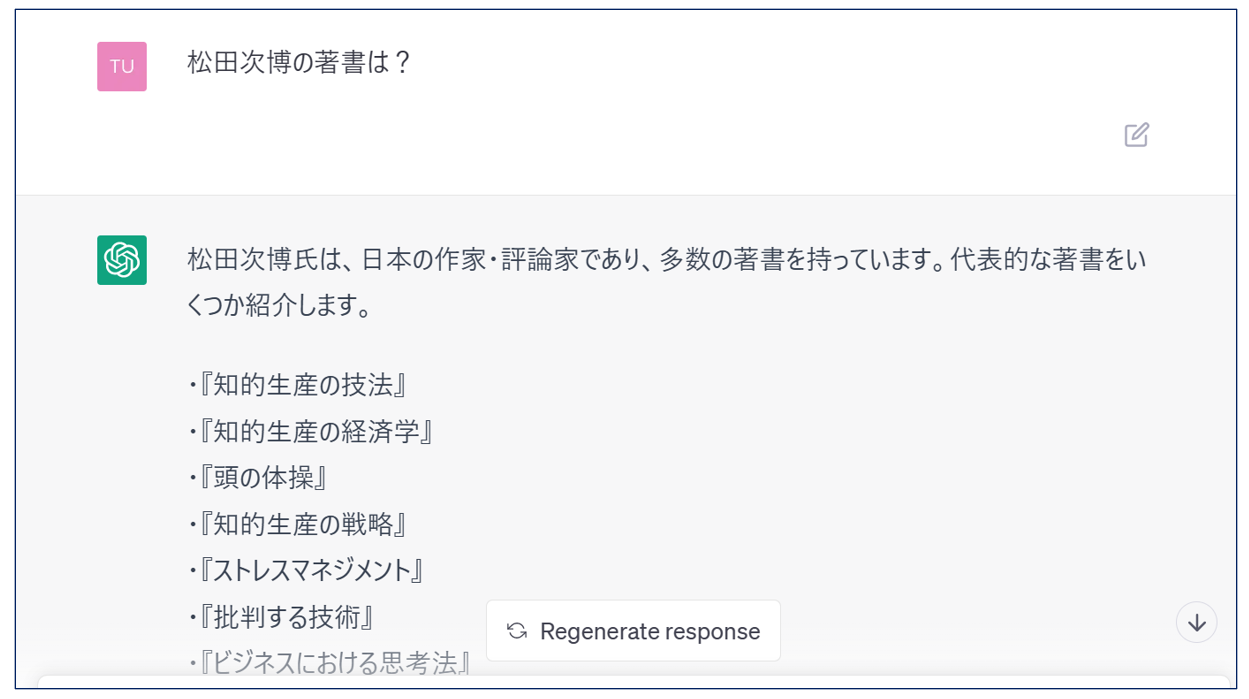

「企業ネットワークを進化させる3大要因は?」という質問に対するChatGPTの回答は80点くらいの出来です。 対して「松田次博の著書は?」への回答はまったくのデタラメ。 不完全なAIははたして業務の効率化とか、生産性向上の役に立つのでしょうか? AIが出したアウトプットのどこが正しく、どこが誤っているのか使う人間が判断できないととんでもないことになります。 もっともらしい回答をそのまま使うと重大なミスが紛れ込む可能性があります。 手間と時間をかけてチェックしても完全な答にたどりつけないかも知れません。

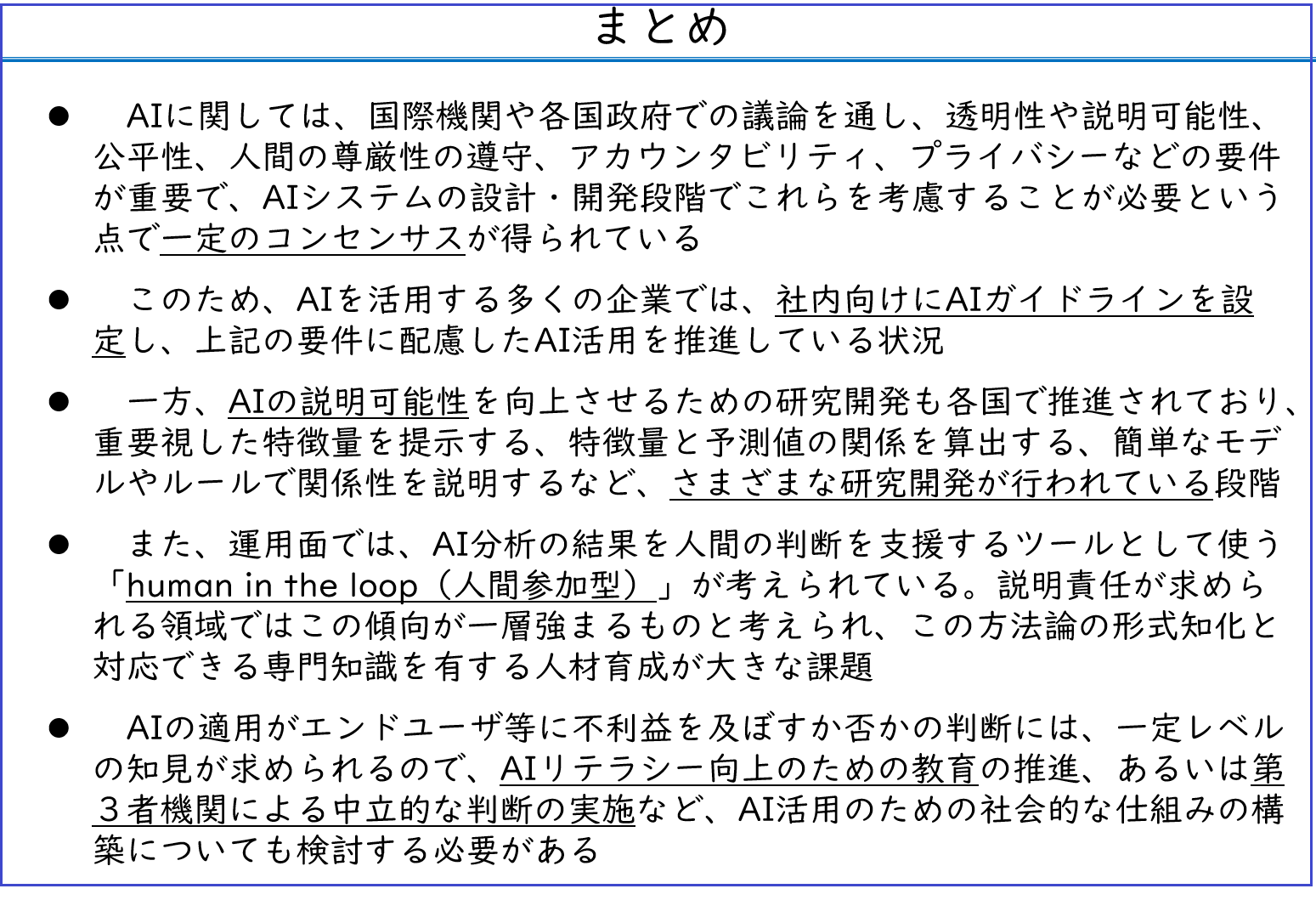

「AIのリスクに関する説明責任の現状と今後の展望」

稲田さんには上記の表題で講演していただきました。 結論のスライドを引用します。

「運用面では、AI分析の結果を人間の判断を支援するツールとして使う「human in the loop(人間参加型)」が考えられている。」とありますが、不完全なAIの場合、結果が使えるかどうか、どの部分を使うべきか、といった難しい判断を人間がしなければならず、「スキルの低い人」ではAIを使いこなせないように思います。 AIはスキルの低い人でも高度なスキルを持った人と同等のことが出来るようにするのが目的だと思うのですが、どうもそれは難しそうです。

*ここに書いてあることで質問、ご意見などありましたらメールでお知らせください。